Deep Natural Language Processing

Einstieg in Word Embedding

Sequence-to-Sequence-Modelle und Transformer mit Python

HANSER Fachbuch |

|

Autor:in |

|

248 Seiten, Hardcover |

|

Erschienen |

04/2022 |

978-3-446-47363-8 9783446473638 |

Im Fokus stehen insbesondere folgende Verfahren:

- Vektorisierung von Wörtern mit Word Embedding.

- Verarbeitung von Texten mit rekurrenten und konvolutionalen neuronalen Netzen.

- Aufbau von Sequence-to-Sequence-Modellen zur Übersetzung und für Textzusammenfassungen.

- Arbeit mit der Transformers-Bibliothek und Hugging Face.

Anhand praktischer Anwendungen (Klassifizierung von Texten, Rechtschreibkorrektur, Übersetzung, Frage-Antwort-System) wird gezeigt, wie sich Textdaten vorbereiten und effektive Lernmodelle mit Bibliotheken wie Transformers, TensorFlow/Keras und Scikit-Learn aufbauen, trainieren und produktiv einsetzen lassen.

Aus dem Inhalt

- Textdaten verarbeiten und vorverarbeiten

- Grundlagen maschinellen Lernens

- Einfache Verfahren zur Vektorisierung von Textdaten

- Deep Learning-Essentials

- Rekurrente Netze

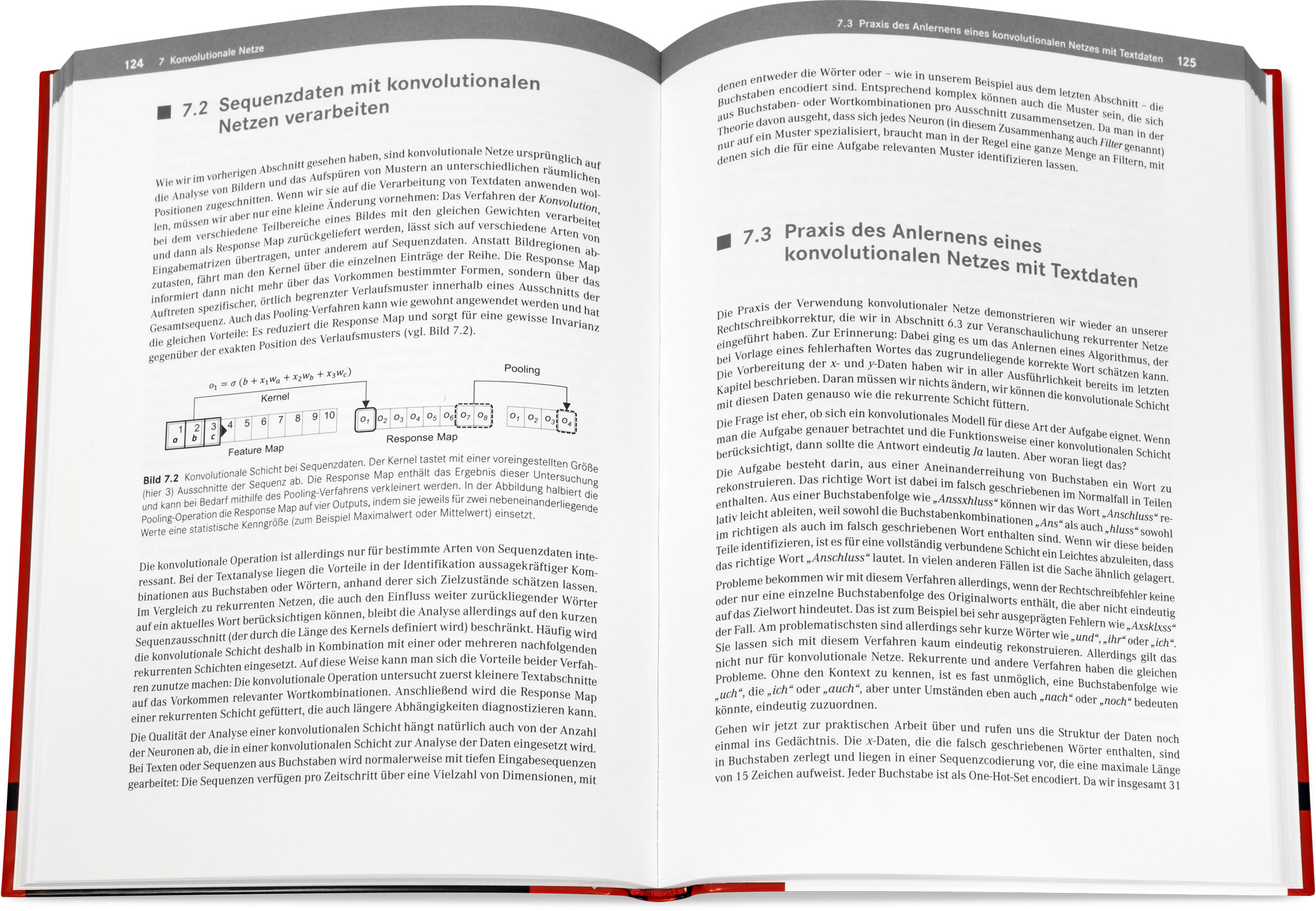

- Konvolutionale Netze

- Word Embedding

- Komplexe Lernarchitekturen umsetzen

- Sequence-to-Sequence-Modelle

- Transformers

Diese Leseprobe behandelt sog. Sequence-to-Sequence-Modelle, mit denen sich ganze Sätze oder Textpassagen erzeugen lassen. Solche Architekturen kommen etwa bei der Übersetzung in oder aus Fremdsprachen zum Einsatz. Die Herausforderung dabei ist es, dass die Bedeutung eines Satzes in verschiedenen Sprachen einem anderen Satzbau folgt, der Satz also zunächst analysiert und nach den Regeln der Zielsprache neu formuliert werden muss.

Wer hat's geschrieben?

Dr. Jochen Hirschle ist zertifizierter Java-Programmierer und als freiberuflicher IT-Trainer und Consultant im Bereich Data Science, Machine und Deep Learning tätig. Zuvor war er Projektleiter in der Marktforschung sowie Dozent und Forscher an den Universitäten in Köln, Innsbruck und Frankfurt/Main.

HANSER Fachbuch |

|

Autor:in |

|

248 Seiten, Hardcover |

|

Erschienen |

04/2022 |

978-3-446-47363-8 9783446473638 |