Der Autor erklärt leicht verständlich, wie Neuronale Netze lernen und wie sie mit Machine-Learning-Verfahren trainiert werden können. Du erfährst, wie du dein erstes Neuronales Netz erstellst und wie es mit Deep-Learning-Algorithmen Bilder erkennen sowie natürliche Sprache verarbeiten und modellieren kann. Hierbei kommen Netze mit mehreren Schichten wie CNNs und RNNs zum Einsatz.

Fokus des Buches ist es, Neuronale Netze zu trainieren, ohne auf vorgefertigte Python-Frameworks zurückzugreifen. So verstehst du Deep Learning von Grund auf und kannst in Zukunft auch komplexe Frameworks erfolgreich für deine Projekte einsetzen.

Aus dem Inhalt

- Parametrische und nichtparametrische Modelle

- Überwachtes und unüberwachtes Lernen

- Vorhersagen mit mehreren Ein- und Ausgaben

- Fehler messen und verringern

- Hot und Cold Learning

- Batch- und stochastischer Gradientenabstieg

- Überanpassung vermeiden

- Generalisierung

- Dropout-Verfahren

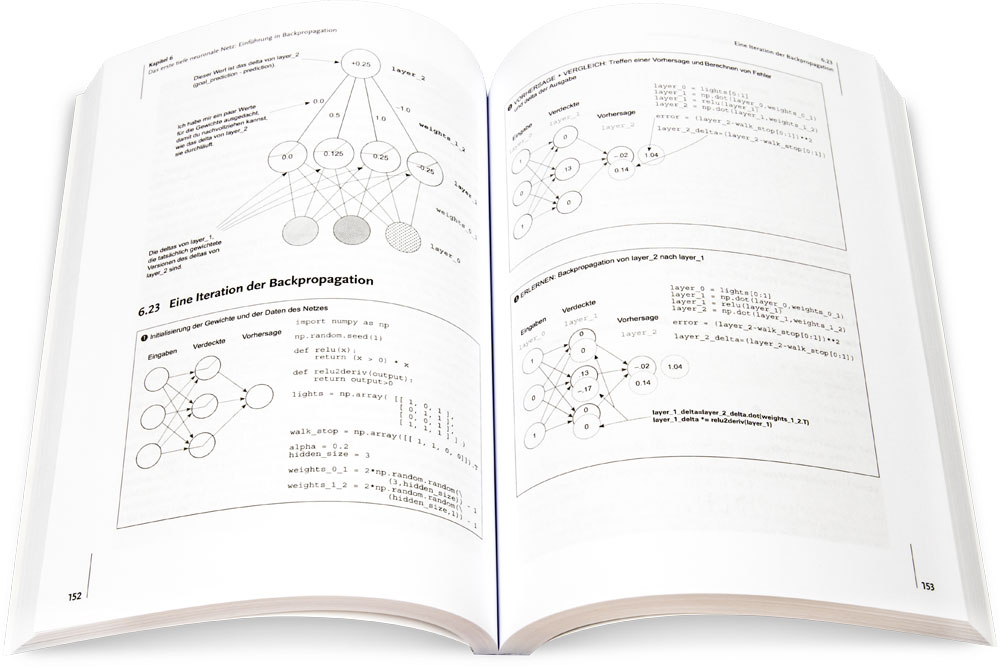

- Backpropagation und Forward Propagation

- Bilderkennung

- Verarbeitung natürlicher Sprache (NLP)

- Sprachmodellierung

- Aktivierungsfunktionen

- Sigmoid-Funktion

- Tangens hyperbolicus

- Softmax

- Convolutional Neural Networks (CNNs)

- Recurrent Neural Networks (RNNs)

- Long Short-Term Memory (LSTM)

- Deep-Learning-Framework erstellen

Wer hat's geschrieben?

Andrew Trask ist Gründungsmitglied von Digital Reasonings Machine Learning Lab, in dem Deep-Learning-Ansätze zur Verarbeitung natürlicher Sprache, Bilderkennung und Audiotranskription erforscht werden. Innerhalb weniger Monate gelang es Andrew und seinen Forschungskollegen, die besten veröffentlichten Ergebnisse bei der Stimmungsanalyse und der automatisierten Zuordnung von Wörtern eines Textes zu Wortgruppen (Part-of-Speech-Tagging) zu übertreffen. Er hat das größte künstliche neuronale Netz mit mehr als 160 Milliarden Parametern trainiert. Die Ergebnisse hat er zusammen mit seinem Koautor auf der internationalen Konferenz über Machine Learning vorgestellt. Sie wurden im Journal of Machine Learning veröffentlicht.